企業における生成AI活用リスク|個人利用とは異なる7つのリスクカテゴリと対策

はじめに

ChatGPTをはじめとする生成AIを業務に導入する企業が急増しています。 しかし、企業での生成AI活用は、個人利用とは異なるリスクが存在することをご存じでしょうか。

日本経済新聞の2024年調査によると、仕事で生成AIを利用している人の割合は44%に達し、前年の18%から大幅に増加しました。一方で、サムスン電子の機密情報漏洩事件や、ディープフェイクを用いた37億円詐欺事件など、生成AI関連のセキュリティインシデントも相次いで報告されています。

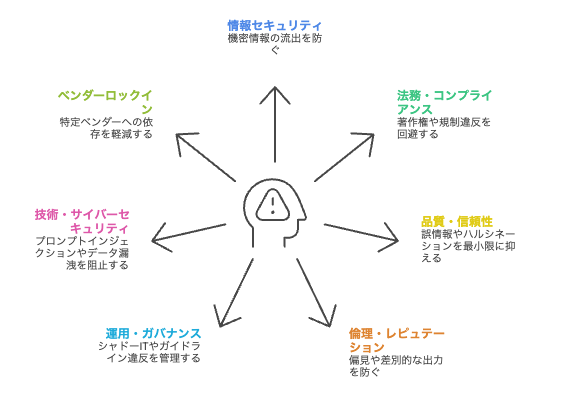

本記事では、企業が生成AIを活用する際に直面する7つのリスクカテゴリと、それぞれの対策について解説します。

個人利用と企業利用の決定的な違い

生成AIのリスクを理解する上で、まず押さえておくべきは「個人利用との違い」です。

個人利用では自己責任の範囲で済む問題でも、企業利用では顧客・取引先・従業員の権利侵害や経営リスクに直結します。守るべきルールも個人情報保護法、労働法、業界ガイドライン、NDAなど多層的になります。

さらに、一人の従業員の誤操作が会社全体の風評被害・賠償責任・業務停止につながる可能性があるため、ツール導入だけでなく、ルール・教育・監査・技術的制御を一体で設計する必要があります。

7つのリスクカテゴリ

1. 情報セキュリティ・機密保持リスク

リスクの内容

社外の生成AIサービスに顧客情報、設計図、ソースコードなどを入力すると、学習やログ保存を通じて第三者に情報が流出するリスクがあります。

2023年4月、サムスン電子ではエンジニアがChatGPTに開発中のソースコードを入力し、機密情報が外部サーバーに保存される事態が発生しました。この事件を受け、同社は社内ネットワークでの生成AI利用を全面禁止する措置を取っています。

また、本人同意のない個人データを外部AIに入力した場合、個人情報保護法違反となる可能性があります。秘密保持契約(NDA)で第三者への提供を禁じている情報を入力すれば、契約違反にもなり得ます。

対策

- 入力データを学習に用いないサービスを選定する

- ログ保存のオプトアウト機能を活用する

- 機密情報の入力を禁止する社内ルールを策定する

2. 法務・コンプライアンス・著作権リスク

リスクの内容

生成AIの出力物が既存の作品やロゴ、人物写真と類似している場合、著作権・商標権・肖像権・パブリシティ権を侵害するリスクがあります。サービスが「商用利用可」であっても、権利侵害が起きないことまでは保証されません。

2023年12月にはニューヨーク・タイムズがOpenAIに対して著作権侵害で訴訟を起こし、生成AI学習における著作物利用の適法性が国際的な論点となっています。

さらに、2024年にはEUでAI規制法(EU AI Act)が採択され、生成AIを含むAI活用全体に対して世界で最も網羅的なルールが定められました。日本でも2024年4月に総務省・経済産業省が「AI事業者ガイドライン」を発表しています。

対策

- 出力物の権利侵害チェック体制を構築する

- AI規制の最新動向を継続的に把握する

- 著作権侵害時の法的責任を負う保険・サービスの活用を検討する

3. 品質・業務上の信頼性リスク(ハルシネーション)

リスクの内容

生成AIは「ハルシネーション」と呼ばれる、もっともらしい誤情報を出力する特性があります。実在しない法令や統計データを事実として生成し、それを基に経営判断を下せば、企業は大きな損失を被る可能性があります。

マニュアル、契約書案、顧客向けFAQ、医療・金融アドバイスなどに誤りが混入すると、クレームや損害賠償、行政処分につながりかねません。

対策

- 出力結果を必ず人間がファクトチェックする運用フローを確立する

- 重要文書への生成AI利用時は複数人レビューを義務化する

- ハルシネーション検知ツールの導入を検討する

4. 倫理・レピュテーション(評判)リスク

リスクの内容

学習データの偏りやモデル特性により、人種・性別・年齢などに関する偏見を含む出力が生じることがあります。そのまま対外的に使用すると差別的表現として炎上の原因になります。

また、AIが生成した誤情報や攻撃的な表現が公式アカウントや顧客対応で出てしまうと、SNSで拡散され企業ブランドが損なわれます。

対策

- 対外発信前のAI出力チェック体制を整備する

- バイアス検証サービスを活用してモデルの偏りを評価する

- 危機管理・炎上対応のマニュアルを準備する

5. 運用・組織・ガバナンスリスク

リスクの内容

現場が個人アカウントや無料サービスで勝手に生成AIを使い始める「シャドーIT」が発生すると、情報管理・ログ管理が効かず、どこに何が入力されたか追跡できなくなります。

「何を入力してよいか」「出力はどこまで信用してよいか」を定めたガイドラインがない状態では、社員ごとの判断に任され、事故リスクが高まります。

対策

- 全社統一の生成AI利用ガイドラインを策定する

- 承認された生成AIツールのみ利用可とするルールを設ける

- 定期的な社内教育・研修を実施する

6. 技術・インフラ・サイバーセキュリティリスク

リスクの内容

外部システムと連携したAIエージェントでは「プロンプトインジェクション」と呼ばれる攻撃手法により、悪意ある入力で意図しない命令実行や情報流出を引き起こすリスクがあります。

2024年3月には、GoogleのGeminiでシステムプロンプトの内容が漏洩する脆弱性が発見されました。また、ChatGPTのアカウント情報がダークウェブ上で大量に売買されている事例も報告されています。

対策

- 侵入防止策、アクセス制御、ログ監視を徹底する

- 生成AIサービスのセキュリティ監査を定期的に実施する

- インシデント発生時の原因究明体制を整備する

7. ベンダーロックイン・コスト管理リスク

リスクの内容

特定ベンダーのAPIやプラットフォームに依存しすぎると、価格改定・仕様変更・サービス停止の影響が大きくなり、切り替えコストも増大します。

クラウド側の障害やモデルアップデートにより、突然レスポンス品質・速度が変わることもあり、業務システム全体の可用性に影響を及ぼす可能性があります。

対策

- 複数ベンダーのサービスを併用・比較検討する

- マルチLLM戦略を採用してリスクを分散する

- 障害時の代替手段を事前に準備する

まとめ

企業における生成AI活用は、個人利用とは比較にならないほど多くのリスクを伴います。しかし、これらのリスクを正しく理解し、適切な対策を講じることで、生成AIの恩恵を安全に享受することが可能です。

重要なのは、ツール導入だけで終わらせず、ルール策定・社員教育・技術的制御・監査体制を一体で設計することです。生成AIの活用が競争優位の源泉となる時代において、リスク管理こそが持続的な価値創出の基盤となります。